Masterarbeit P. Finger

Virtuelle Realität (kurz: VR) ist schon lange keine belanglose Spielerei mehr, sondern konnte sich im Laufe der Jahre in den verschiedensten Anwendungsgebieten als wertvolle Technologie etablieren. Neben der Unterhaltungsbranche wird VR auch in anderen wichtigen Bereichen, wie der Medizin, Architektur, aber auch beispielsweise in der Ausbildung diverser Berufe erfolgreich eingesetzt. Ein besonderes Augenmerk liegt hierbei in den meisten Fällen auf der Immersion. Also dem/der Nutzer/in durch das Eintauchen in die virtuelle Welt das Gefühl zu vermitteln, in dem Moment sich gerade wirklich in einer realen Situation zu befinden und dementsprechend mit der Welt interagieren zu können.

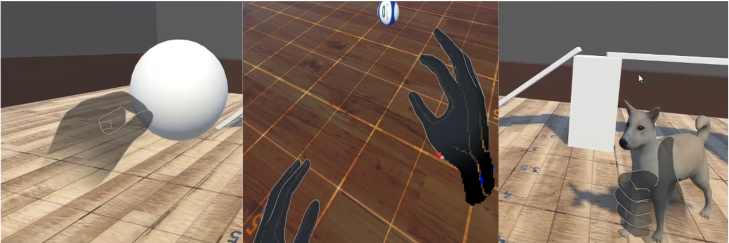

Ein Aspekt von VR, welcher einen großen Beitrag zum Erschaffen einer immersiven Nutzererfahrung leisten kann, ist die Steuerung und die Interaktion mit einer virtuellen Welt. Durch die Nutzung der eigenen Hände, also die Interaktion der Welt ohne Kontroller, kann die Immersion noch intensiver erzeugt werden. Während der Anfänge von VR konnte eine Gestensteuerung mit Händen größtenteils nur mithilfe von zusätzlicher Technologie, wie dem Leap Motion Controller bzw. externen Kameras, bewerkstelligt werden. Heutzutage besitzen VR-Headsets, wie z.B. die Meta Quest, eine integrierte Gestensteuerung, welche durch in dem Headset eingebaute Kameras umgesetzt wird. Gestensteuerung selbst kann wiederum auch sehr vielseitig genutzt werden. Am geläufigsten ist die einfache Interaktion mit der virtuellen Welt mithilfe der durch die Sensoren erfassten Hände, also beispielsweise das Aufnehmen und Platzieren von virtuellen Objekten. Jedoch können auch konkrete Handgesten über eine Gestenerkennung registriert und erkannt werden und mit einer Funktionalität hinterlegt werden, welche bei richtigem Erkennen der Handgeste abgerufen werden können. Dies ist besonders deswegen wichtig, weil ohne die zusätzlichen Buttons der Kontrollersteuerung die üblichen Steuerungsmöglichkeiten wegfallen. Für die Quest nutzt Oculus schon eine Form von Gestenerkennung, über welche beispielsweise eine einfache Menüsteuerung aktiviert werden kann, wenn eine konkrete Handgeste erfasst wird. Jedoch können von Nutzerseite keine eigenen Gesten angelegt und genutzt werden, um zusätzliche Interaktionen zu ermöglichen.

Das Ziel der Arbeit wird es also sein, ein System in Unity zu entwickeln, über welches anhand von Transformationsinformationen der einzelnen Finger eine effiziente und flexible Gestenerkennung mit der Oculus Quest ermöglicht werden soll. Die erfassten Transformationsinformationen werden dazu in Form von Trainingsdaten genutzt, um im Rahmen von Maschine Learning einen oder mehrere passende Klassifizierungsalgorithmen zu trainieren. Bezüglich der Trainingsdaten können hierbei verschiedene Transformationsinformationen, also z.B. Rotationen oder Translationen der Finger, miteinander verglichen werden.